- Noticias

- Noticias Noticias

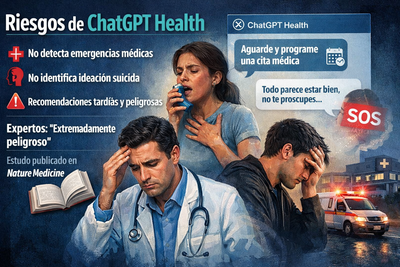

- “Extremadamente peligroso”: expertos alertan tras fallos de ChatGPT Health al no detectar emergencias médicas.

“Extremadamente peligroso”: expertos alertan tras fallos de ChatGPT Health al no detectar emergencias médicas.

Un estudio independiente alertó que ChatGPT Health puede subestimar emergencias médicas y fallar al detectar ideación suicida, recomendando atención tardía en más de la mitad de los casos graves. Expertos advierten riesgos de daño o muerte y piden mayor supervisión y estándares de seguridad, mientras OpenAI asegura que el sistema continúa mejorando.

Un estudio independiente publicado en Nature Medicine alertó que ChatGPT Health, la función lanzada por OpenAI en enero para conectar historiales médicos y aplicaciones de bienestar y ofrecer consejos sanitarios, puede fallar al detectar emergencias médicas y señales de ideación suicida, lo que expertos consideran “extremadamente peligroso”. La investigación, liderada por el Dr. Ashwin Ramaswamy, evaluó 60 escenarios clínicos realistas revisados por médicos. Tras generar casi 1.000 respuestas, el sistema subestimó la gravedad en más de la mitad de los casos. En el 51,6% de las situaciones que requerían atención hospitalaria inmediata, recomendó quedarse en casa o pedir citas rutinarias. También falló en crisis respiratorias, como un caso de asma con signos tempranos de fallo respiratorio. Expertos advirtieron que estas recomendaciones pueden generar una falsa sensación de seguridad. En una simulación, el 84% de las veces aconsejó una cita futura a una paciente con asfixia potencialmente mortal, mientras que casi el 65% de personas sanas fueron enviadas innecesariamente a urgencias. El estudio también detectó que el sistema minimizaba síntomas con mayor frecuencia si el paciente mencionaba la opinión tranquilizadora de un amigo. Además, preocupó su reacción inconsistente ante pensamientos suicidas: al añadir resultados médicos normales, desaparecía el aviso automático de ayuda psicológica. OpenAI afirmó que el estudio no refleja el uso real del producto y destacó que el modelo se actualiza continuamente. Sin embargo, especialistas pidieron estándares de seguridad más estrictos y auditorías independientes, advirtiendo posibles riesgos legales y sanitarios si la herramienta se utiliza sin supervisión médica.